Gözden Kaçırmayın

Felçli Hastalarda Umut: Düşünceler Artık Konuşmaya Dönüşüyor

Felçli Hastalarda Umut: Düşünceler Artık Konuşmaya DönüşüyorYapay Zekanın Etik Sınavı: Hukuk, Sağlık ve Akademi Üçgeninde Kritik Uyarılar

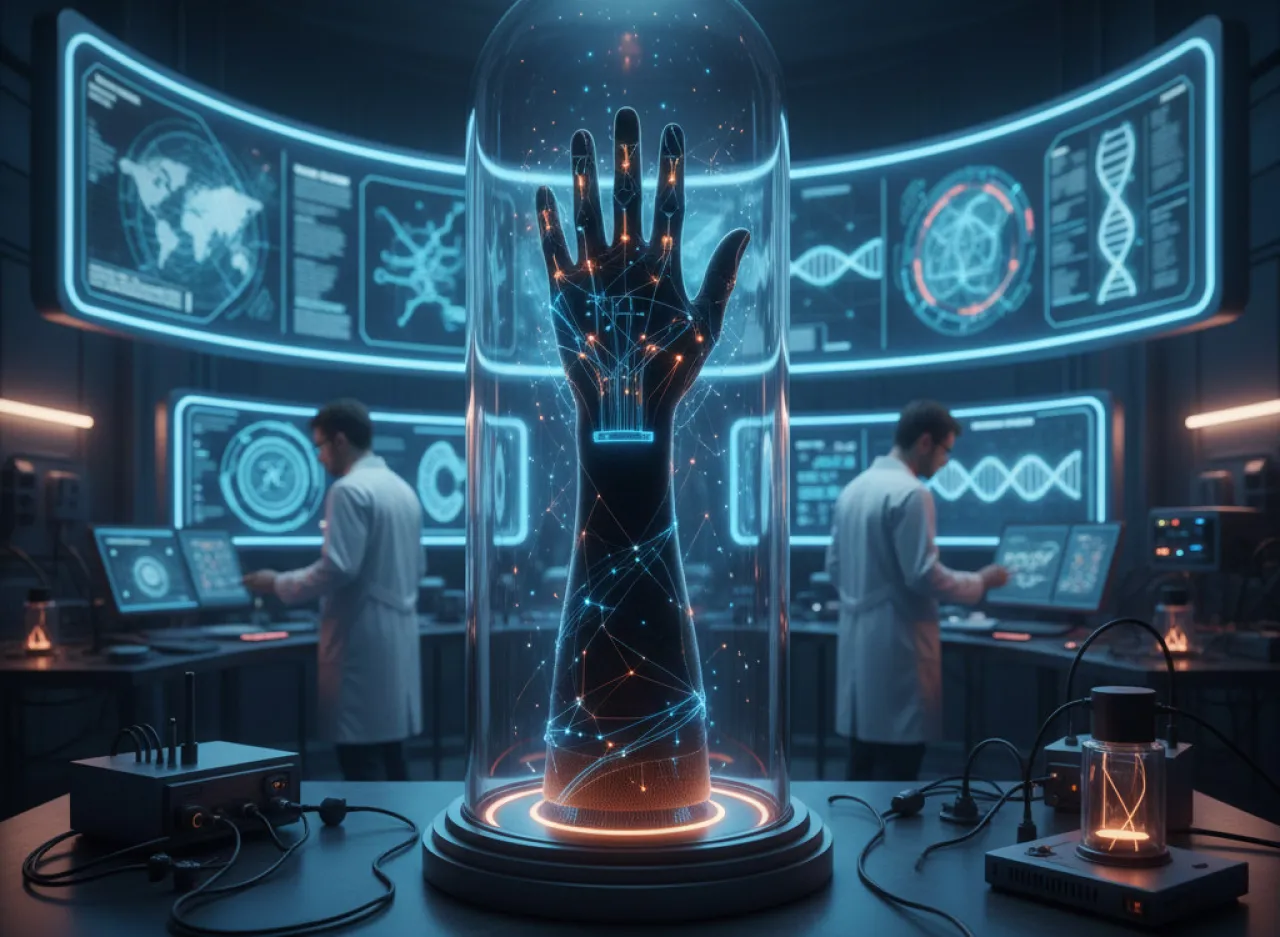

Yapay zeka teknolojisinin hızla yaygınlaşması, beraberinde ciddi etik ve hukuki sorunları da getiriyor. Akademik çalışmalardan sağlık teşhislerine kadar pek çok alanda kullanılan YZ sistemleri, "kara kutu" problemi, sorumluluk belirsizliği ve veri gizliliği ihlalleriyle karşı karşıya.

MEDTRUST Forumu'nda ele alınan vakalar, özellikle sağlık sektöründeki riskleri gözler önüne serdi. İstinye Üniversitesi ve Patoloji Dernekleri Federasyonu iş birliğiyle düzenlenen forumda, yapay zekanın tıbbi teşhislerdeki hata payı ve bu hataların hukuki sorumluluğu masaya yatırıldı.

Sağlıkta Yapay Zeka: Kim Sorumlu Olacak?

Sağlık sektöründe yapay zeka kullanımı en kritik tartışma alanlarından biri. Yanlış kanser teşhisi veya hatalı tedavi önerileri durumunda sorumluluğun kime ait olacağı belirsizliğini koruyor. YZ geliştiricisi mi, hastane mi yoksa doktor mu sorumlu tutulacak? Bu belirsizlik, hastaların haklarını korumayı zorlaştırıyor.

Özellikle dermatoloji alanında yaşanan cilt tonu algılama hataları, farklı etnik grupların teşhis ve tedavisinde adaletsizliğe yol açabiliyor. Eğitim verilerindeki önyargılar, YZ sistemlerinin azınlık grupları için düşük performans göstermesine neden oluyor.

Akademik Dünyada Etik İhlal Riskleri

TÜBTAK ve YÖK rehberleri, akademik çalışmalarda yapay zeka kullanımının şeffaflık ilkesi çerçevesinde beyan edilmesini zorunlu kılıyor. Araştırmacılar, YZ'nin hangi aşamada, hangi amaçla ve ne ölçüde kullanıldığını belirtmekle yükümlü.

Beyan yükümlülüğünün ihlali, ciddi akademik ve hukuki sonuçlar doğurabiliyor. Yapay zeka ile üretilen verilerin insan eliyle oluşturulduğu iddiası, bilimsel sahtekarlık olarak değerlendirilebiliyor. Bu durumda proje fonlarının iadesi, akademik unvanların iptali ve hatta adli soruşturma riski bulunuyor.

AB Yapay Zeka Tüzüğü ve Türkiye'deki Durum

Avrupa Birliği'nin yürürlüğe koyduğu Yapay Zeka Tüzüğü, yüksek riskli YZ sistemleri için denetim mekanizmaları getiriyor. Tüzük, temel hakların korunması, güvenlik ve demokratik değerlerin güvence altına alınmasını amaçlıyor. Şeffaflık zorunluluğu ile YZ'nin kararlarının insanlar tarafından anlaşılabilir hale getirilmesi gerekiyor.

Türkiye'de ise 6698 sayılı Kişisel Verilerin Korunması Kanunu (KVKK) çerçevesinde denetimler artıyor. Ancak YZ'nin "veri sorumlusu" olarak tanımlanması konusundaki tartışmalar devam ediyor. Kişisel verilerin işlenmesi ve korunmasına ilişkin mevzuat, yapay zeka sistemlerinin neden olduğu yeni risklere tam olarak yanıt veremiyor.

Çözüm Önerileri ve Gelecek Perspektifi

Uzmanlar, yapay zeka etiği konusunda kapsamlı bir yaklaşım öneriyor. Akademik kurumların YZ kullanımını denetimli bir şekilde uygulaması, sağlık sektörünün YZ sistemlerini sertifikalandırması ve hukuki çerçevenin YZ'nin sorumluluk modelini netleştirmesi gerekiyor.

Toplumun YZ'nin etik riskleri hakkında eğitim alması da kritik önem taşıyor. Şeffaflık, adalet ve hesap verebilirlik ilkeleri, yapay zekanın güvenilir ve etik bir şekilde kullanılması için vazgeçilmez unsurlar olarak öne çıkıyor.

Editör Yorumu

Yapay zeka teknolojisinin hızla gelişmesi, mevcut hukuki ve etik çerçeveleri zorluyor. Özellikle sağlık ve akademi gibi insan hayatını doğrudan etkileyen alanlarda, denetim mekanizmalarının acilen güçlendirilmesi gerekiyor. AB'nin Yapay Zeka Tüzüğü, küresel ölçekte önemli bir adım olsa da ulusal mevzuatların bu düzenlemelerle uyumlu hale getirilmesi kritik önem taşıyor. Yapay zeka etiği konusunda multidisipliner bir yaklaşım ve sivil toplumun aktif katılımı, teknolojinin insan yararına kullanılmasını sağlayacaktır.

Yorumlar

Yorum Yap